Benutzer-Werkzeuge

se:multimedia

**Dies ist eine alte Version des Dokuments!**

Inhaltsverzeichnis

Multimedia

Lernziele

- die physiognomischen Eigenheiten von Hören und Sehen kennen

- den Aufbau analoger Fernsehübertragungstechnik kennen

- das analoge Fernsehsignal in seinen Grundzügen nachvollziehen

- die Motivation der digitalen Signalverarbeitung nachvollziehen

- Methoden und Begriffe der Digitalisierung analoger Signale kennen

- wichtige Begriffe der Datenkompression und Datencodierung kennen

- verlustfreie und verlustbehaftete Kompressionsmethoden kennen

Einleitung

- Kommunikation ist die zielgerichtete, kanalgebundene Übertragung von Informationen von einem Sender zu einem oder mehreren Empfängern.

- Kommunikationskanäle zwischen Menschen

- textuell (Wort und Schrift)

- visuell (Licht und Farbe)

- auditiv (Ton, Klang, Sprache)

- taktil (Fühlen von Kräften, Texturen, Temperaturen)

- olfaktorisch (Riechen und Schmecken)

* Wahrnehmung von Bewegung und Beschleunigung

* im Zentrum von Multimedia stehen Menschen und ihre Wege, mit anderen Menschen und ihrer Umwelt zu kommunizieren

- Multimedia ist der Trend, die Kanäle, über die Menschen mit ihrer Umwelt kommunizieren, mit Mitteln der Informationswissenschaft über alle Quellen zu integrieren und als Gesamtheit für die Kommunikation zu nutzen.

- Multimedia-Kanäle: Text, Bild, Film/Video, Internet, Virtual Reality, Audio

Wahrnehmung

Hören

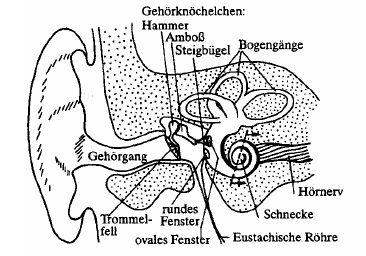

- akustische Phänomene, die das Gehör wahrnimmt, sind Kompressionen und Verdünnungen der Luftmoleküle

- die Druckwellen treffen auf das Trommelfell und werden über die Ohrknöchelchen an die Cochlea übermittelt

- feine Flimmerhärchen in der mit Lymphflüssigkeit gefüllten Cochlea schwingen und geben elektrische Impulse ans Gehirn weiter

- das menschliche Gehör kann Schallereignisse im Bereich von 18 Hz bis 20.000 Hz wahrnehmen

- Töne tiefer Frequenz benötigen einen höheren Schalldruck, um wahrgenommen zu werden → Hörschwelle

- Schmerzschwelle: Schalldruck, ab dem die Rezeption zu Schmerzempfinden führt

- Hörfeld: Bereich zwischen Hörschwelle und Schmerzschwelle

- Einheiten

- physikalisch: Dezibel als (logarithmische) Einheit für den Schalldruck → menschliche Wahrnehmung ist nicht linear zur Frequenz

- phsychoakustisch: Phon als Einheit für die Lautstärke (Lautstärkeempfinden von Frequenzen im Bezug auf den 1kHz-Sinuston) → kein quantitativer Vergleich von Lautstärken möglich, da Lautstärkeempfinden nicht proportional zu den Phon-Werten ist

- Sone (N) als Einheit für die (subjektive!) Lautheit (qualitativer Vergleich von Klangereignissen), 1 sone = 40 Phon

* Umrechnung: N = 2<sup>(L<sub>N</sub> - 40) / 10</sup> * {{:se:dBPhonSone.jpg|}}* Psychoakustik: Teilgebiet der Psychophysik, das versucht, die Zusammenhänge zwischen physikalischen Eigenschaften von Schallsignalen und dem menschlichen Hörempfinden zu beschreiben

- psychoakustische Phänomene

- tonale Maskierung: schmalbandiger Schall einer bestimmten Intensität löscht Frequenzen geringerer Lautstärke in seinem Frequenzumfeld aus (Mithörschwelle: Grenze, ab der der Ton wahrgenommen wird), Effekt ist abhängig von Frequenz und Schallpegel des Maskierers

- temporale Maskierung (Vor- und Nachverdeckung): Maskierung vor (20ms) und nach (200ms) Auftreten des Maskierers

- Schwebung und Rauhigkeit: zwei Töne ähnlicher Frequenz werden als ein Ton bestimmter Tonhöhe wahrgenommen, wobei der Schall durch die Phasenverschiebung eine Schwebung erfährt

- je größer die Frequenzdifferenz, umso rauher klingt der Ton, bishin zur Wahrnehmung zweier unterschiedlicher Töne

* Residuum: Töne von Instrumenten setzen sich aus Grundton und Obertönen (Harmonische, Frequenzen sind ganzzahlige Vielfache des Grundtons) zusammen, filtert man den Grundton heraus, vervollständigt das menschliche Gehör die fehlende(n) Grundschwingung(en) zum ursprünglichen Klangbild

* kritische Bänder: Schallereignisse werden in Frequenzgruppen wahrgenommen, deren Gruppenbreite mit steigender Frequenz zunimmt

Sehen

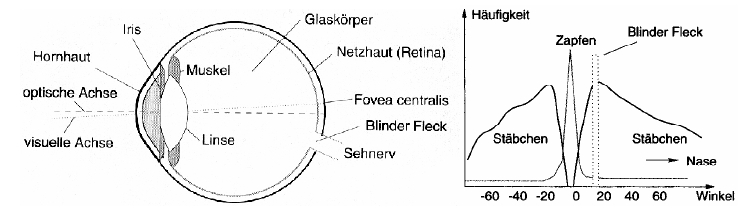

- Licht fällt durch die Hornhaus, Iris und Linse auf die Netzhaut (Retina)

- Rezeptoren auf der Retina wandeln die Lichtinformationen in elektrische Impulse

* Zapfen: farb-/helligkeitsempfindlich, 3 Typen: A grün, B gelb-rot, C violett, arbeiten bei Tageslicht optimal, Anzahl 6 Millionen * Stäbchen: nur helligkeitsempfindlich, empfindlicher als Zapfen, Anzahl 120 Millionen

* fovea centralis: Punkt größter Sehschärfe, hier sind nur Zapfen vorhanden

- wahrnehmbares Licht: 780nm (rot) - 390nm (violett)

- blinder Fleck: hier bündeln sich die Nervenbahnen des Auges zum Sehnerv

- das Auflösungsvermögen des Auges ist biologisch begrenzt

- bestimmte Detailtiefe wird nicht mehr wahrgenommen

- ruhende Objekte werden besser erfasst als sich bewegende

- Helligkeitsunterschiede werden besser erfasst als Farbunterschiede

- maximale Farbempfindlichkeit bei gelb-grün

- 20 Bilder pro Sekunde werden bereits als kontinuierliche Bildfolge wahrgenommen

Analoge Fernsehtechnik

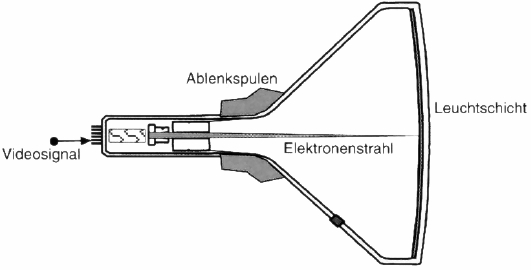

- Elektronen werden durch Magnetspulen abgelenkt und bringen auf einer Mattscheibe ein fluoreszierendes Material zum Leuchten

- Elektronenstrahl läuft zeilenweise über das Bild, Nachleuchten der Fluoreszenzschicht vermittelt Eindruck eines Bildes

- inverse Funktionsweise kann für Kameras verwendet werden

- Erkenntnisse über das Auflösungsvermögen des Auges führten zu einer Zahl von mindestens 600 Zeilen pro Bild

* alle Zeilen nacheinander abzuarbeiten (progressive, 25 Vollbilder) führt zu Flimmern → interlaced mode (50 Halbbilder) - Parameter von PAL

- 625 Zeilen, 576 sichtbar

- Vertikalfrequenz: 50Hz, Bilddauer 20ms

* Horizontalfrequenz: 50 * 312,5 = 15625Hz, Zeilendauer 64 Mikrosekunden * YUV Farbmodell

* Signalübertragung

- Bild-Austastung-Synchronisation (BAS)

* {{:se:BAS.jpg|}} * Bildsignal: analoge Grauwertübertragung einer Bildzeile, Signalbereich 0,7 Volt * Austastungssignal: Signal beim Strahlenrücklauf (horizontal vs. vertikal), Pegel unter Schwarzbereich, in Austastlücke werden Metainformationen übertragen (VPS, Videotext, Prüfsignale) * Synchronisationssignal: dient der Synchronisation jeder Bildzeile/Halbbild, Übertragung in der Austastlücke* Farbsysteme

- additiv: selbstleuchtende Farben (z.B. Fernseh-/Computerbildschirme), RGB, alle Farben zusammen ergeben weiß

- subtraktiv: beleuchtete Träger (z.B. Offsetdruck), CMYK, alle Farben zusammen ergeben schwarz

- Farbfernsehen: PAL → YUV-Modell (Y = Helligkeit/Luminanz, UV = Farbdifferenz/Chrominanz)

- Y = 0,299R + 0,587G + 0,114B

- U = (B - Y) * 0,493

- V = (R - Y) * 0,877

- gelb-grün-Anteil trägt wesentlich zum Helligkeitsempfinden bei

- Kameras enthalten Rot-, Grün- und Blaufilter

- Farbmonitore enthalten drei Elektronenquellen

- BAS → FBAS (F = Farbe): Übertragung der Fardifferenzen in der Austastlücke

* Fernsehstandards - NTSC (National Television Systems Committee): 720x485x30, YiQ Farbmodell

- PAL (Phase Alternating Line): 720x576x25, YUV Farbmodell

- SECAM (sequentiel couleur a memoire): Abwandlung von PAL, YiQ Farbmodell

Digitalisierung

- bis in die 90er Jahre wurden mediale Inhalte hautpsächlich analog produziert und rezipiert (Schallplatten, Musikkassette, VHS)

- Unterschiede analog/digital

- kontinuierliche, analoge Signale <> diskontinuierliche, diskrete Signale

- Generationsverlust <> kein Generationsverlust

- Störanfälligkeit im Übertragungskanal <> binäre Übertragung

* Vorteile der Digitalisierung - Computer arbeiten digital

- die Bearbeitung und Verarbeitung von Medien in digitaler Form ist einfacher

- Datenkompression ist in digitalen Formaten einfacher zu realisieren

- Fehlerschutz- und -korrekturmechanismen sind möglich

* Kopien sind ohne Generationsverlust durchführbar (entscheidender Punkt!)

* Digitalisierung von Audioinhalten

- liegen als kontinuierliche, analoge, elektrische Signale vor → unendlich viele Werte beliebiger genauer Auflösung

- Abtastung zu bestimmten Zeitpunkten und Überführung in diskreten Wertebereich → Digitalisierung

- Abtast-/Samplingrate: Frequenz, mit der Werte im Signal abgetastet werden

- Shannon-Nyquist-Theorem: fa > 2 * fmaxHz

* wird das SNT missachtet kann das Ausgangssignal nach der Digitalisierung nicht mehr eindeutig rekonstruiert werden * menschliches Gehör kann bis zu 20kHz wahrnehmen -> Abtastrate > 40kHz * **Quantisierung**: Überführung der kontinuierlichen Amplitudenwerte eines Signals in diskrete Werte * Auflösung in bit legt die Anzahl der zulässigen Werte fest * Quantisierungsfehler wird umso größer, je geringer die Auflösung ist -> bei Audio als Rauschen hörbar * Signal to Noise Ratio (SNR): SNR = 20 * log (A<sub>Signal</sub> / A<sub>Rauschen</sub>) dB * jedes zusätzliche Bit in der Quantisierungsauflösung resultiert in einer Erhöhung der Klangdynamik um 6dB bei gleichzeitiger Reduzierung des Rauschens um 6dB * Pulse Code Modulation (PCM): linear = gleichmäßige Quantisierungsstufen, nicht-linear = logarithmische Quantisierungsstufen -> geringere Auflösung im unteren Wertebereich * CD-Audio: Abtastrate 44kHz, Auflösung 16bit

* Digitalisierung von Bildinhalten

- Zerlegung des Bildes in Raster bestimmter Auflösung, zeilenweise Abtastung

- Auflösung: Anzahl Zeilen und Bildpunkte pro Zeile

- Quantisierung: Anzahl der Graustufen pro Pixel

Datenkompression

- Ablauf

- ein Signal x wird durch einen Encoder in ein komprimiertes Signal y gewandelt und durch den Übertragungskanal geschickt

- der Empfänger ermittelt mit Hilfe eines Decoders das Ausgangssignal x'

- bei verlustloser Kompression werden redundante Informationen gelöscht (Entropiekodierung) und x' entspricht genau x

* bei verlustbehafteter Kompression werden irrelevante Informationen gelöscht und x' ist nicht gleich x

* Anforderungen an Kompressionsverfahren

- minimale Anzahl an bits

- Eindeutigkeit / Rekonstruierbarkeit

- kleinstmöglicher Unterschied zwischen Eingangs- und Ausgangssignal

- Kategorien: Entropiecodierung / Quellencodierung

- Reduktion redundanter Daten <> Reduktion irrelevanter Daten

- universell <> an zu komprimierenden Datenstrom angepasst

- verlustfrei <> verlustbehaftet

* Entropiecodierung: Verfahren, bei denen Auftrittswahrscheinlichkeiten zwischen verschiedenen unabhängigen Symbolen eines Alphabets zur Reduktion der Datenmenge ausgenutzt werden

- Informationsgehalt eines Zeichens: Ii = log (1 / pi) bit

- Entropie: mittlerer Informationsgehalt, Summe der Produkte aus Wahrscheinlichkeiten und Informationsgehalten aller Symbole

- statistische Codierungsverfahren versuchen, dem Wert H für die Entropie möglichst nahe zu kommen, Symbole mit hoher Wahrscheinlichkeit bekommen kürzere Codewörter zugewiesen

- Problem bei Codewörtern ungleicher Länge: Trennzeichen sind nötig oder Verwendung von Prefix-Codes

- Huffman-Code als Beispiel für Prefix-Codes

- Präcodierung: betrachtet die Korrelation von Symbolen in einem zeitdiskreten Signal und versucht, die Intersymbolredundanz zu verringern

- Lauflängencodierung (RLE): nur effektiv wenn Basis des Zahlensystems klein und Anzahl der Wiederholungen (runs) groß ist

- statische Patternsubstitution: bestimmte Symbolfolgen treten häufig auf und bekommen fixe kurze Codeworte zugewiesen (z.B. "sch" in der deutschen Sprache)

- ein Escape-Zeichen ist nötig

* Lempel-Ziv-Welch (LZW): alle Symbole werden in das Ausgangswörterbuch geschrieben, dann wird dieses dynamisch vercollständigt

* Quellencodierung

- Gruppe der Dekorrelation: Prädiktion und Transformationscodierung

- Prädiktion: basiert auf differentieller Codierung, versucht Aussagen über Signalwerte anhand bereits bekannter Signalwerte zu treffen

- Wert wird einem Prädiktormodul zugeführt, das einen Schätzwert ermittelt, der Unterschied zum tatsächlichen Wert (tatsächlicher Wert - Schätzwert) wird dann übertragen

- Nachteil: Pufferung der bisherigen Werte notwendig

- einfachste Form: Differential Pulse Code Modulation (DPCM) bei Audiosignalen, Schätzwert = vorheriger Wert

- Prädiktion bei Bilddaten: kontextabhängige Prädiktormodi z.B. zum Erkennen einer vertikalen Kante

- Transformationscodierung: Transformierung vom Orts-/Zeitraum in den Frequenzraum (damit kann leichter gearbeitet werden und es bieten sich mehr Möglichkeiten für Kompression)

- Transformation ist nicht verlustbehaftet und reversibel

- wichtige Transformationen: Discrete Fourier Transformation (DFT, bei Audiokompression) und Discrete-Cosinus-Transformation (DCT, bei Bild- und Videokompression)

Links

ToDo

- Unterscheidung BAS / FBAS

- LZW und Huffman im Baum durchspielen

Klausur

- Gegenüberstellungen

- Zusammenhänge

- Detailfragen

- Flash-Codeausschnitte kommentieren

- Hilfsmittel: Taschenrechner

- Skype: maddias.r

Begriffe

-

- Ein Algorithmus ist eine eindeutige Abbildung.

-

- Zu jedem Zeitpunkt ist der nachfolgende Abarbeitungsschritt eines Algorithmus eindeutig festgelegt.

* Kontinuität (analoge Signale) - lückenloser Zusammenhang, Stetigkeit, stetige Werte

-

- räumliche oder zeitliche Trennung von Objekten oder Ereignissen

* Periode = Schwingungsdauer T - Eine Periode ist die kleinste Zeitdauer einer sich wiederholenden physikalischen Erscheinung.

- Frequenz f

- Kehrwert der Periode

* harmonische Schwingung - Zeitabhängigkeit der veränderlichen Zustandsgrößen ist sinusförmig.

- t und F sind unabhängig von Amplitude.

* Konvergenz <> Divergenz - Existenz eines Grenzwertes bei einer Folge

-

- Gebilde mit hoher Selbstähnlichkeit (Beispiel: Mandelbrot-Menge)

* Korrelation - Beziehung zwischen zwei oder mehr statistischen Variablen (nicht zwingend kausal).

ToRead

- DIN 33401

se/multimedia.1237725084.txt.gz · Zuletzt geändert: 2014-04-05 11:42 (Externe Bearbeitung)