Benutzer-Werkzeuge

se:informationstheorie

**Dies ist eine alte Version des Dokuments!**

Inhaltsverzeichnis

Informationstheorie und Codierung

Überblick

- Quellencodierung beseitigt Redundanz in der Nachricht

- Kanalcodierung fügt der Nachricht wieder Redundanz hinzu (z.B. zur Fehlerkorrektur)

Informationstheorie

- basiert auf grundlegenden Arbeiten von Shannon

- eine Quelle liefert informationskennzeichnende Zeichen xi aus einem q Zeichen umfassenden Alphabet X mit gewissen Wahrscheinlichkeiten

- bei stationäre Quellen sind die Wahrscheinlichkeiten, mit denen die Quelle Zeichen abgibt nicht von der Zeit abhängig

- bei gedächtnislosen Quellen sind die Wahrscheinlichkeiten der Zeichen unabhängig von zuvor oder im Anschluss gesendeten Zeichen

- aus den Elementen des Zeichenvorrats können Worte wi der Länge mi gebildet werden. Es lassen sich qm verschiedene Worte gleicher Länge m herstellen

- eine Codierung ist die Vorschrift zur eindeutigen Abbildung der Zeichen eines Zeichenvorrats A auf Codeworte, die aus den Zeichen eines Zeichenvorrats B gebildet werden: C(xi) = wi

- Beispiele für Codes: Morse-Code, ASCII-Code, Dezimal-, Oktalzahlen etc.

- Information ist Abbau von Ungewissheit (Beispiel Zufallsexperiment: Ausgang vorher unbekannt, danach bekannt)

- Informationsgehalt I(xi)/bit = -ld p(xi)

- I(xi, xj) = I(xi) + I(xj)

- der Informationsgehalt ist umso größer, je unwahrscheinlicher das Zeichen ist

- jedes Zeichen eines binären Zeichenvorrats hat bei gleichwahrscheinlichem Auftreten einen Informationsgehalt von -ld (0,5) = 1

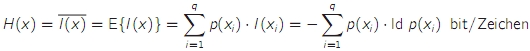

- die Entropie H ist der mittlere Informationsgehalt der Zeichen einer Quelle → Maß für statistische Unordnung bzw. Unsicherheit

- die Entropie ist der Erwartungswert des Informationsgehalts

- die Entropie wird maximal, wenn alle Zeichen eines Zeichenvorrats gleich wahrscheinlich sind, Bezeichnung: Hmax oder H0

- die maximale Entropie wird auch als Entscheidungsgehalt einer Quelle bezeichnet

- der Unterschied zwischen H(x) und H0 wird als Redundanz bezeichnet: p = H0 - H(x)

- eine Redundanz kann auch für Codes angegeben werden: pcode = L - H(x) mit L = mittlere Codewortlänge

- relative Coderedundanz oder Weitschweifigkeit: (L - H(x)) / L, Codeeffizienz: H(x) / L

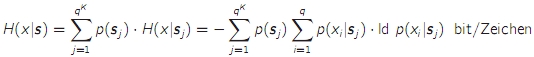

- eine Quelle, deren Gedächtnis K Zeichen in die Vergangenheit reicht, wird als Markov-Quelle K-ter Ordnung bezeichnet

- allg. Markov-Quelle = Markov-Quelle 1. Ordnung, gedächtnislose Quelle = Markov-Quelle 0. Ordnung

- die bedingte Entropie ist der Mittelwert (über alle Zustände) des mittleren Informationsgehalts eines Zeichens, das in einem bestimmten Zustand der Quelle abgegeben wird

se/informationstheorie.1235238074.txt.gz · Zuletzt geändert: 2014-04-05 11:42 (Externe Bearbeitung)